Các mục nhập dữ liệu riêng lẻ được lưu trữ dưới dạng “ Tenxơ ” trong PyTorch và “ Độ dốc ” của tensor được tính toán bằng cách sử dụng phương pháp truyền ngược trong vòng huấn luyện của mô hình học sâu. Thuật ngữ “ không có tỷ lệ ” có nghĩa là dữ liệu ở dạng thô và không cần xử lý trước hoặc tối ưu hóa. Độ dốc không chia tỷ lệ của Tensor cung cấp giá trị thay đổi thực sự về hàm mất mát đã chỉ định.

Trong blog này, chúng ta sẽ thảo luận về cách tính độ dốc không định tỷ lệ của Tensor trong PyTorch.

Độ dốc không được chia tỷ lệ của Tensor trong PyTorch là gì?

Tensors là mảng đa chiều chứa dữ liệu và có thể chạy trên GPU trong PyTorch. Các tensor chứa dữ liệu thô từ tập dữ liệu mà không có bất kỳ quá trình xử lý trước, biến đổi hoặc tối ưu hóa nào được gọi là tensor không chia tỷ lệ. Tuy nhiên, một “ Độ dốc không được chia tỷ lệ ” khác với tenxơ không chia tỷ lệ và phải cẩn thận để không nhầm lẫn giữa hai loại này. Độ dốc không chia tỷ lệ của một tenxơ được tính toán tương ứng với hàm mất mát đã chọn và nó không có bất kỳ tối ưu hóa hoặc chia tỷ lệ nào nữa.

Làm cách nào để tính toán độ dốc không định tỷ lệ của Tensor trong PyTorch?

Độ dốc không định tỷ lệ của Tensor là giá trị thực tế của tốc độ thay đổi của dữ liệu đầu vào liên quan đến hàm mất đã chọn. Dữ liệu gradient thô rất quan trọng để hiểu hành vi của mô hình và tiến trình của nó trong vòng huấn luyện.

Thực hiện theo các bước bên dưới để tìm hiểu cách tính độ dốc không định tỷ lệ của tenxơ trong PyTorch:

Bước 1: Bắt đầu dự án bằng cách thiết lập IDE

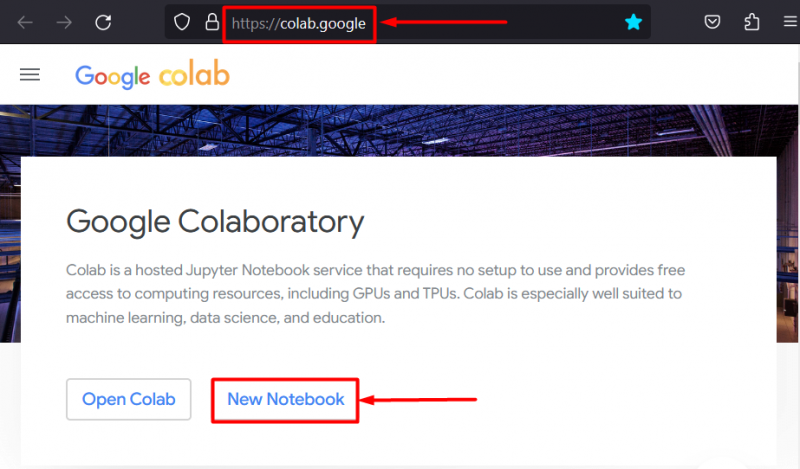

Google Colaboratory IDE là một trong những lựa chọn tốt nhất để phát triển các dự án PyTorch vì nó cung cấp quyền truy cập miễn phí vào GPU để xử lý nhanh hơn. Đi tới Colab trang mạng và nhấp chuột vào “ Sổ tay mới ” tùy chọn để bắt đầu làm việc:

Bước 2: Nhập thư viện Essential Torch

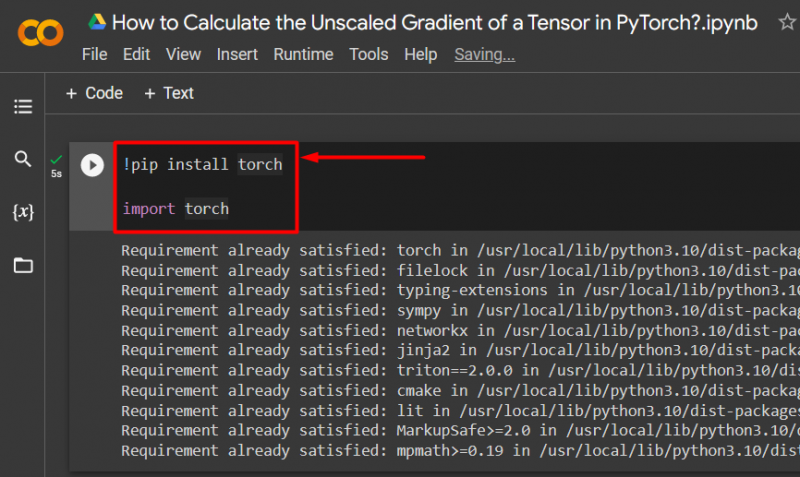

Tất cả chức năng của khung PyTorch đều có trong “ Ngọn đuốc ' thư viện. Mọi dự án PyTorch đều bắt đầu bằng cách cài đặt và nhập thư viện này:

!pip cài đặt ngọn đuốcngọn đuốc nhập khẩu

Đoạn mã trên hoạt động như sau:

- “! pip ” là gói cài đặt Python dùng để cài đặt thư viện trong các dự án.

- Các ' nhập khẩu Lệnh ” dùng để gọi các thư viện đã cài đặt vào dự án.

- Dự án này chỉ cần chức năng của “ ngọn đuốc ' thư viện:

Bước 3: Xác định Tensor PyTorch bằng gradient

Sử dụng ' ngọn đuốc.tensor ()” để xác định một tensor có độ dốc “ require_grad=Đúng ' phương pháp:

A = torch.tensor([5.0], require_grad=True)Bước 4: Xác định hàm mất mát đơn giản

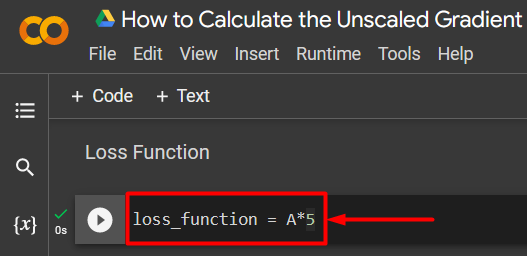

Hàm mất được xác định bằng phương trình số học đơn giản như sau:

loss_function = A*5

Bước 5: Tính toán độ dốc và in ra đầu ra

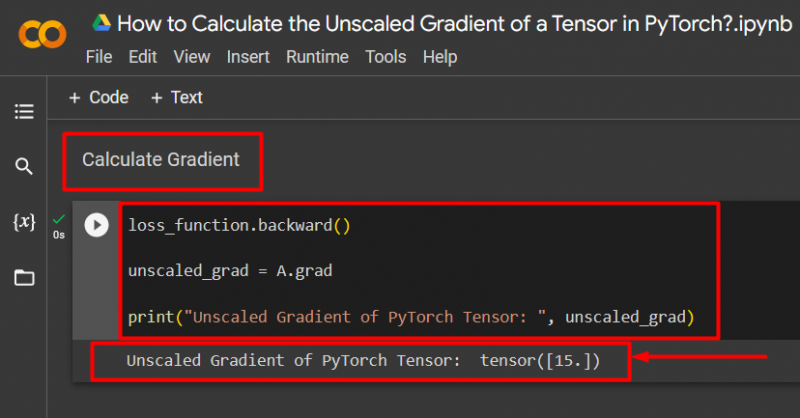

Sử dụng ' phía sau ()” để tính gradient không chia tỷ lệ như hình:

loss_function.backward()unscaled_grad = A.grad

print('Độ dốc không định tỷ lệ của PyTorch Tensor: ', unscaled_grad)

Đoạn mã trên hoạt động như sau:

- Sử dụng ' phía sau ()” để tính toán độ dốc không định tỷ lệ thông qua truyền ngược.

- Chỉ định “ A.grad ” đến “ không chia tỷ lệ_grad ' Biến đổi.

- Cuối cùng, hãy sử dụng “ in ()” để hiển thị đầu ra của gradient chưa được chia tỷ lệ:

Ghi chú : Bạn có thể truy cập Colab Notebook của chúng tôi tại đây liên kết .

Mẹo chuyên nghiệp

Độ dốc không định tỷ lệ của các tensor có thể hiển thị mối quan hệ chính xác của dữ liệu đầu vào với hàm mất mát cho mạng thần kinh trong khung PyTorch. Độ dốc thô chưa được chỉnh sửa cho thấy cả hai giá trị có liên quan một cách có hệ thống như thế nào.

Thành công! Chúng tôi vừa trình bày cách tính gradient không định tỷ lệ của tensor trong PyTorch.

Phần kết luận

Tính toán độ dốc không định tỷ lệ của một tenxơ trong PyTorch bằng cách trước tiên xác định tenxơ, sau đó sử dụng phương thức back() để tìm độ dốc. Điều này cho thấy mô hình học sâu liên hệ dữ liệu đầu vào với hàm mất mát được xác định như thế nào. Trong blog này, chúng tôi đã đưa ra hướng dẫn từng bước về cách tính gradient không chia tỷ lệ của tensor trong PyTorch.